人工智能的核心命题,正从“屏幕对话”转向“拥有身体的智能”。近期,我国首个《人形机器人与具身智能标准体系(2026版)》发布,标志着产业迈入规范化新阶段。但标准之下,一个更深层的追问依然待解:具身智能的瓶颈,究竟在哪?

机器人能听懂指令、看懂环境,却常在细微动作上出错――插头歪一毫米插不进、不知如何绕开行人、拧螺丝一用力就打滑。这揭示了一个核心困境:“听得懂、看得懂”不等于“做得到、做得好”。机器人能认出杯子,是语义知识的理解;却无法掌控抓握杯子的力度,是物理经验的缺失。

我们认为,行业瓶颈不在单一算法的改进,而在两处根源:大规模高质量具身交互数据的匮乏,以及机器人“大小脑”能力体系的结构性断层。

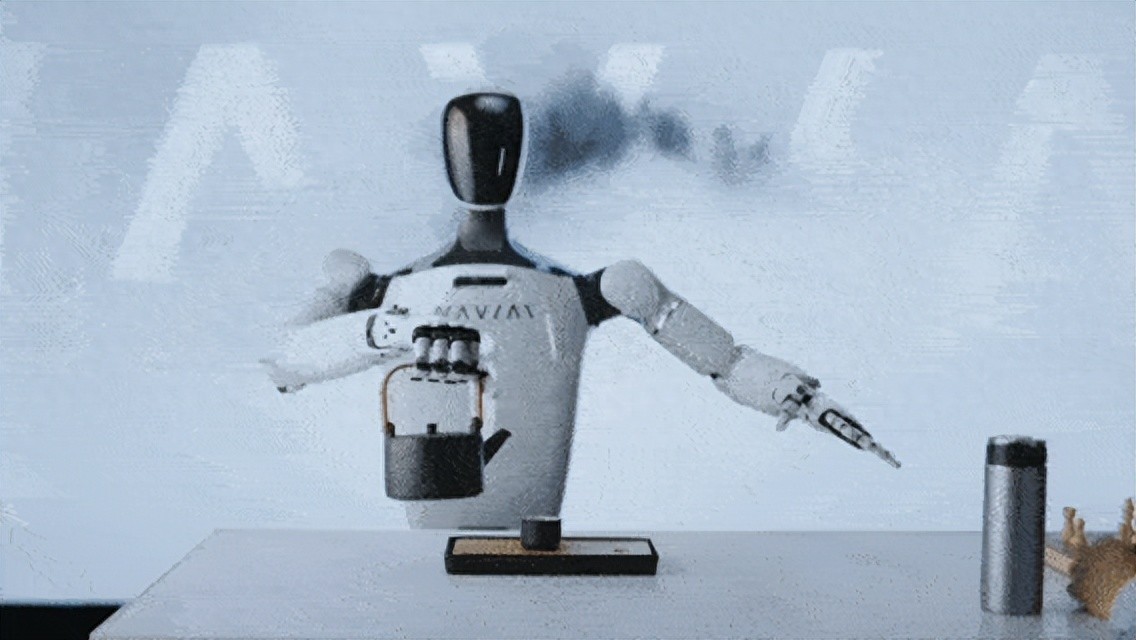

面对这一现状,浙江人形从源头破局:以多源数据融合体系实现低成本、高质量数据的大规模获取,以“双螺旋”模型架构弥合“智能执行”的断层,解决物理经验的缺失问题。我们正在打通一条从“看得懂”到“做得好”的完整路径,让具身智能在真实场景中不断学习、进化、落地。

具身智能模型体系SPIRE架构图

01

数据筑基:

三源融合,毫米映射+毫秒级协同

数据是机器人的“教科书”。在具身智能数据方面,浙江人形采用“义务教育+高等教育+职业教育”的三源融合数据体系建设,融合视、听、力、触等物理交互的多模态数据,让机器人学得更快、看得更清、做得更准、适应更强。

浙江人形的数据策略,就像把模型培养成一个“通专兼备的复合型人才”:

人类数据 = 义务教育:通过大规模的人类行为数据预训练,让模型获得通识理解能力,知道“正常人会怎么做”。仿真数据 = 高等教育:通过真实场景的高保真重构与数据生成扩增,让模型在仿真中大规模反复练习,掌握可泛化精准作业的基础知识。真机数据 = 职业教育:通过多模态真机数据,在特定场景中高效完成真实任务,让模型“毕业即上岗”。

人类数据:提供行为示范与策略参考,筑基物理交互

第一视角人类行为数据采集

浙江人形打造了高效率的人类行为数据解析和映射方法,对采用消费级相机采集的人类第一/第三视角数据进行处理,可准确提取出人类的作业顺序、物体掩膜、6D位姿、手势轨迹及手-物接触关系,精度达到毫米级,并通过手势重定向快速映射至高自由度灵巧手,为抓取等技能学习奠定数据基础。

四个视角的人类行为数据采集

高自由度灵巧手数据解析与映射

仿真数据:低成本高保真覆盖,拓边长尾场景

高保真场景重建与渲染

浙江人形搭建了完整的仿真数据生成链路,自研高精度场景和物体重建、多模态高保真数据生成算法,支持场景级、物体级数据的采集、重构、编辑、适配等全链路real2sim流程,可输出RGB图像、深度图像、语义真值。

场景渲染性能超过现有开源方案11%,复杂场景mesh重建几何精度超SOTA(State Of The Art,最先进水平)10%,并可基于单条演示数据实现行为扩增,大幅提升数据利用效率,增强机器人对光照、纹理、动态等物理变化的适应能力。

大规模仿真数据采集

真机数据:贴近物理规律,夯实数据基石

全身协同的视力触位多模态数据采集

浙江人形从数据和模型两方面解决物理交互Sim2Real问题,数据方面自研全身协同控制算法,实现头、手、臂、腰全身联动和柔顺交互,且求解时间小于10ms,跟踪精度优于1mm,支撑视觉、力觉、触觉、运动轨迹信息的精准获取,通过真机数据实现机器人sim2real的技能校准,是“真刀真枪”的经验沉淀。

多场景多任务遥操数据采集

浙江人形构建的多源数据体系,形成三大核心优势:

多源互补:人类筑基、仿真拓边、真机夯实,三类数据形成闭环,兼顾真实性与泛化能力;高效保真:协同控制求解快,仿真链路高保真,消费级采集成本低,打通规模化学习路径;技术贯通:从数据采集、标注到映射,全链路自主掌握,支撑高动态精准移动操作学习。02

模型双擎:

“大脑”高维度认知推理,“小脑”微米级泛化作业

当前具身智能大脑模型普遍采用VLM为骨干网络,以继承其内在的语义泛化能力。但由于VLM的训练数据仅有语言和2D图像、缺少大规模的物理交互数据,大脑模型缺乏对空间位姿、几何结构等物理状态的认知能力,长程任务容易出现幻觉。同时,具身智能小脑模型仅依赖视觉输入,缺少力触感知,动作精准性欠缺。

针对这一根本性缺陷,浙江人形提出“原生+借智”的模型策略,一方面增强VLM的能力:在保留其语义泛化能力的同时,注入几何理解、闭环反思能力,实现长序列鲁棒作业;另一方面,模型原生支持从视力触位等物理交互数据中学习,完成多种可泛化高精准技能,进一步结合VLM提升中程作业智能性和物体语义作业能力。

长序列导航任务决策与规划

浙江人形自研的具身智能SPIRE系统可灵活实现大小脑解耦和融合:

C2L2(cognitive close-loop long sequence task planning model 混杂开放场景的长序列鲁棒作业大脑):负责环境认知、长程推理、任务拆解与自主纠错,让机器人“听得懂、看得准、想得清”;M2S2(multi-modal semantic skill 可泛化高精准的多模态语义技能小脑):负责将语义指令转化为高精准物理动作,融合多模态感知,保障实时性与安全性,让机器人“抓得稳、行得巧、干得灵”。

精准倒液技能误差小于1ml,可适应透明液体

例如在康养服务场景中,机器人接到“倒出10毫升止咳糖浆”的指令后,大脑(C2L2)理解任务目标并自动拆解为“抓取药瓶、打开瓶盖、抓取量杯、倒出糖浆、放下量杯、关盖收瓶”等子步骤;小脑(M2S2)则负责将大脑的决策转化为精准物理动作,以倒出糖浆为例,视力触觉融合感控保证对准瓶口和杯口、倾斜倒液、观察刻度、收瓶归位,大小脑配合完成目标任务。

当环境变化时,大脑(C2L2)进行推理调整,例如桌面上没有止咳糖浆时,需要确定搜索空间和搜索行为。当容器和液体的种类、形态、目标刻度发生变化时,小脑做泛化适应――让机器人成长为无需外脑的专业型人才。这套能力同样可迁移至工业、服务等领域的复杂精准作业。

这一升级,是具身智能通往真正通用化的最稳健、最可扩展的路径,构筑了商业拓展的“护城河”,让浙江人形在汽车制造、实验化工、仓储物流等场景中快速交付稳定可靠的产品,成为应用落地的领先者。

C2L2:混杂开放场景的长序列鲁棒作业大脑模型

浙江人形自主研发的C2L2大脑模型,让机器人成为“运筹帷幄的司令员”。

C2L2 根据任务指令调整场景中物体的空间状态

看得准――能准确理解场景中物体的空间状态;

拆得明――将复杂的长序列任务自动拆解为有序的子任务,让机器人“心中有谱、手中有序”;

找得到――具备主动探索能力,即使物品被遮挡或不在视野中,也能通过环境感知与推理“找到它、够得着”;

调得快――作业过程中实时感知异常、自主纠错,遇到卡顿或偏差能“自我调整、不卡壳”。

C2L2 基于单张图像参考调整场景中物体的空间状态

针对大脑对物理状态理解缺失的问题,浙江人形将环境和对象的几何结构、执行效果评估等知识引入VLM,使语义规划能够直接考虑真实物理约束,实现将高层语言指令转化为具备物理可行性的操作子目标。

C2L2 实现长程任务拆解与自主纠错,具备探索能力

这一认知驱动的长序列规划模型,复杂任务成功率达94%,未知环境实现拟人化导航,高动态复杂场景成功率超SOTA算法50%,有力支撑开箱即用与人机共融。

C2L2实现跨场景多任务端到端轨迹生成与迁移泛化

M2S2:可泛化高精准的多模态语义技能小脑模型

浙江人形自主研发的M2S2小脑模型,让机器人拥有“眼到手到,刚柔并济”的金牌工匠级操作能力。

M2S2 自适应柔顺抓取

对得准――视觉毫米级对准,比头发丝还细;

抓得稳――力觉泛化柔顺抓取,不滑不碎不伤物体;

行得巧――动态移动避障,在人群中自如拟人穿行;

干得灵――视力触融合,布料分片、轴孔装配、试剂分液等多类操作都能精准完成。

M2S2 基于单张图像引导完成精准打螺丝作业

针对小脑对视力触信息融合不足、精准性不够的问题,浙江人形在模型上采用注意力机制对三种模态进行编码和融合,辅以稠密表征提高精准性,并引入物理约束,使动作预测考虑机器人的可执行能力。

这一知识学习型的视力触融合感控技能模型,装配精度可达0.03mm,成功率99.99%,性能指标全面国际领先,已应用于华为、BEKO、施耐德等工业产线。

M2S2 动态环境中实现安全拟人避障

依托M2S2小脑模型的视力触融合技术,浙江人形在柔性布料分片作业任务中已取得实质性领先进展。

在机器人领域,布料是公认的“操作噩梦”――视觉看不清边界、力觉控不准力道、触觉感知不到滑移。传统机器人面对布料要么束手无策,要么暴力抓取导致撕裂或粘连。

浙江人形让机器人同时调用三大感官:通过视觉识别布料的形变特征与堆叠边界,结合力觉实时感知双手协同操作下的布料应力及厚度变化,同时依托触觉闭环反馈指尖与布料间的多维接触状态,实现揉搓方式的动态调整。

M2S2 视力触感知融合实现布料精准分片

这项技术使布料分片成功率从行业平均不足60%跃升至98%,单次操作仅需3秒,已覆盖棉布、牛仔布、无纺布等多种柔性材质。依托浙江人形自研的小脑模型,机器人可完成透明液体精准分液、多规格料箱泛化搬运、堆叠柔性螺纹管分拣等实际作业任务。

M2S2 泛化搬运支持多种不同规格料箱

M2S2 突破杂乱堆叠下无纹理的螺纹管分拣

从大脑的高维度认知推理,到小脑的视力触融合与微米级泛化作业,浙江人形“原生+借智”的模型策略破解了具身智能“看得懂却做不好”的结构性断层。

C2L2大脑模型让机器人拥有运筹帷幄的智慧,M2S2小脑模型赋予机器人眼到手到的技艺――二者各司其职,又相辅相成。

无论是康养场景中精准倒液的举一反三,还是工业产线上0.03mm的轴孔装配,这套“大脑+小脑”的双擎体系,正在让机器人从依赖外脑的指令执行者,成长为无需外脑的专业型人才。

然而,再聪明的模型也需要持续“喂养”。每一次精准操作背后,都是一条高质量的数据轨迹;每一条数据轨迹,又成为模型进化的燃料。这就引出了我们的第三个答案――数据与模型的双螺旋飞轮。

03

飞轮进化:

越学越聪明,越干越精通

浙江人形解决具身智能瓶颈的路径清晰而有力:一手抓数据,一手抓模型,让两者互为燃料、螺旋上升。

数据是根基,模型是引擎。两者并非孤立存在,而是形成了一个持续加速的进化飞轮:SPIRE系统在真实场景中每完成一次作业,就生成一条高质量的多模态感知-决策-行为数据,这些数据反哺给模型,让模型越训练越聪明;更聪明的模型又能完成更复杂的任务,产生更多高质量的数据。

落地越广,进化越快――商业与技术由此实现同频共振。

这不仅是技术的突破,更是中国在定义下一代物理智能的范式。真正的具身智能,不是写在代码里的预设程序,而是在一次又一次的抓取、装配、揉搓中,亲手长出来的经验与智慧。

展望未来,这条“越学越聪明,越干越精通”的路将把机器人从实验室的炫技,带进车间、仓库、商场乃至家庭。

当数据飞轮加速转动,机器人将不再是预设程序的执行者,而成为在真实世界中不断积累经验、自我优化、举一反三的新质生产力工具。

浙江人形将继续以“数据+模型”双轮驱动,深耕真实场景,携手全球生态伙伴,共同推动人形机器人从“能用”走向“好用”,从“专用”走向“通用”。让每一个机器人都成为无需外脑的专业型人才――这是我们的方向,也是具身智能的未来。

往期精选

关于我们

浙江人形机器人创新中心有限公司成立于2023年12月,由熊蓉教授团队携手多家知名产业伙伴共同创立,是一家专注于具身智能人形机器人关键技术攻关、产品研发与行业应用推广的高科技企业。我们长期聚焦于世界模型与具身智能的前沿探索,致力于研发能够真正落地、服务多场景的人形机器人产品。

公司技术已实现了软硬件的全栈自主可控:完整覆盖关节―臂―手―腿―腰―头―颈的全身本体研制,贯通感知―决策―规划―控制的全链条智能,并拥有端到端的大小脑模型,构筑起“整机设计―数据平台―模型训练―部署应用”的完整自主研发闭环。同时,公司构建了以双臂手作业能力为核心、双足前沿探索与轮式方案并行的立体布局,形成了软硬件深度融合,覆盖多行业、多场景的产品矩阵。

【免责声明】【广告】本文仅代表作者本人观点,与和讯网无关。和讯网站对文中陈述、观点判断保持中立,不对所包含内容的准确性、可靠性或完整性提供任何明示或暗示的保证。请读者仅作参考,并请自行承担全部责任。邮箱:

三一生活网

三一生活网